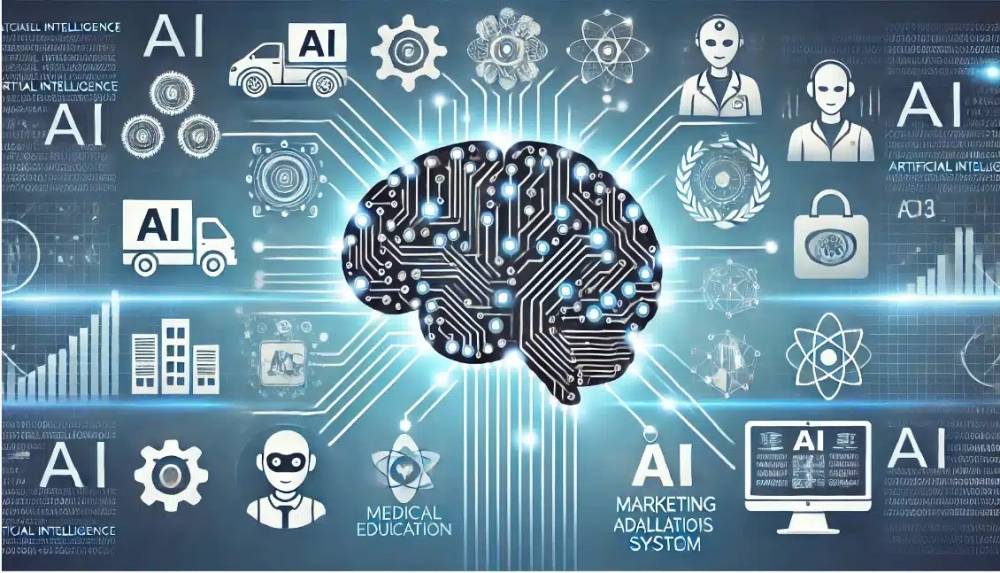

Quy định AI (AI Regulations) là tập hợp các quy tắc, luật lệ và chính sách được xây dựng để quản lý việc phát triển, triển khai và sử dụng trí tuệ nhân tạo (AI). Khi công nghệ AI ngày càng len lỏi vào mọi lĩnh vực – từ y tế, tài chính đến giao thông – việc thiết lập các quy định trở nên cấp thiết để đảm bảo an toàn, minh bạch và trách nhiệm. Người dùng tìm kiếm “quy định AI” thường muốn hiểu rõ cách các chính phủ và tổ chức quốc tế kiểm soát công nghệ này, cũng như tác động của chúng đến doanh nghiệp và cá nhân.

Mục tiêu của quy định AI là gì?

Bảo vệ quyền lợi người dùng: Đảm bảo AI không gây hại hoặc phân biệt đối xử.

Thúc đẩy đổi mới: Tạo môi trường pháp lý rõ ràng để doanh nghiệp phát triển AI.

Đảm bảo đạo đức: Ngăn chặn lạm dụng AI trong các lĩnh vực nhạy cảm.

Trong bài viết này, chúng ta sẽ khám phá các khía cạnh quan trọng của quy định AI, từ các chính sách AI toàn cầu đến những bộ luật cụ thể như EU AI Act, giúp bạn hiểu rõ hơn về bối cảnh pháp lý và cách nó ảnh hưởng đến tương lai của AI.

AI có khả năng thay đổi thế giới, nhưng nếu không được kiểm soát, nó có thể dẫn đến những rủi ro lớn. Ví dụ, các thuật toán AI không được kiểm soát chặt chẽ có thể tạo ra kết quả thiên vị hoặc vi phạm quyền riêng tư. Quy định AI giúp giải quyết những vấn đề này bằng cách:

Bảo vệ dữ liệu cá nhân: Đảm bảo các hệ thống AI tuân thủ luật bảo vệ dữ liệu như GDPR.

Ngăn chặn thiên vị thuật toán: Yêu cầu các nhà phát triển AI kiểm tra và sửa chữa các lỗi thiên vị trong hệ thống.

Tăng cường an toàn: Đặc biệt trong các ứng dụng AI nguy cơ cao như xe tự lái hoặc chẩn đoán y tế.

Một ví dụ thực tế là trường hợp các công ty công nghệ bị phạt hàng triệu đô la vì sử dụng AI vi phạm quyền riêng tư. Những quy định này không chỉ bảo vệ người dùng mà còn giúp doanh nghiệp tránh được các rủi ro pháp lý.

Trên thế giới, nhiều quốc gia và khu vực đã bắt đầu xây dựng các chính sách AI toàn cầu để quản lý công nghệ này. Dưới đây là một số ví dụ nổi bật:

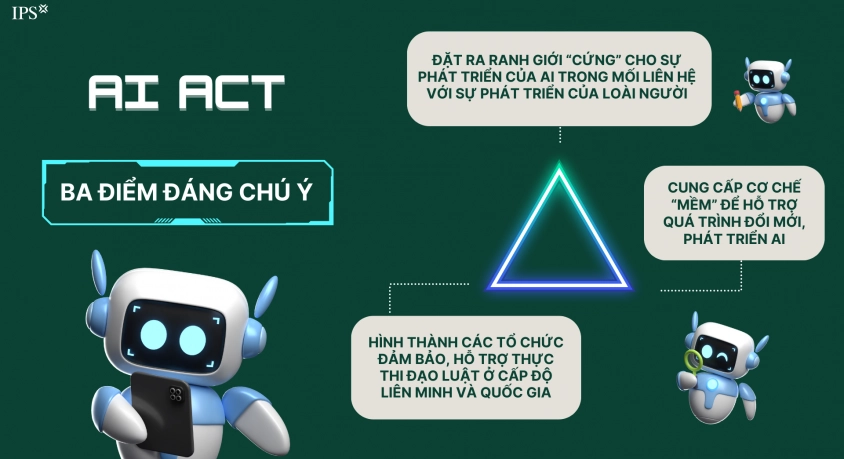

EU AI Act là một trong những bộ luật toàn diện nhất về AI hiện nay, được Liên minh châu Âu (EU) thông qua để quản lý việc sử dụng AI trong khu vực. Bộ luật này phân loại các ứng dụng AI theo mức độ rủi ro:

Rủi ro thấp: Các ứng dụng như chatbot hoặc hệ thống gợi ý nội dung.

Rủi ro trung bình: AI trong giáo dục hoặc tuyển dụng, cần minh bạch.

Rủi ro cao: AI trong y tế, giao thông hoặc tư pháp, yêu cầu kiểm soát nghiêm ngặt.

Không được phép: Các ứng dụng AI vi phạm quyền con người, như hệ thống giám sát hàng loạt.

EU AI Act yêu cầu các doanh nghiệp cung cấp thông tin rõ ràng về cách AI hoạt động, đảm bảo tính minh bạch và trách nhiệm. Ví dụ, nếu một công ty sử dụng AI để tuyển dụng, họ phải công khai cách thuật toán đưa ra quyết định.

Khác với EU, Hoa Kỳ áp dụng cách tiếp cận phân quyền hơn, tập trung vào các hướng dẫn tự nguyện thay vì luật bắt buộc. Các cơ quan như NIST (Viện Tiêu chuẩn và Công nghệ Quốc gia) đã phát triển khung quản lý rủi ro AI, khuyến khích doanh nghiệp tự điều chỉnh. Tuy nhiên, một số bang như California đang xem xét các quy định nghiêm ngặt hơn, đặc biệt trong lĩnh vực bảo mật dữ liệu.

Trung Quốc có cách tiếp cận tập trung, với các quy định nghiêm ngặt về nội dung AI và giám sát dữ liệu. Các công ty AI tại đây phải tuân thủ các quy tắc về kiểm duyệt nội dung và bảo mật thông tin. Điều này giúp chính phủ kiểm soát chặt chẽ cách AI được sử dụng, nhưng cũng làm dấy lên lo ngại về quyền riêng tư.

Nhiều quốc gia như Canada, Nhật Bản và Úc cũng đang phát triển các chính sách AI toàn cầu. Ví dụ, Canada tập trung vào việc sử dụng AI có đạo đức, trong khi Nhật Bản ưu tiên thúc đẩy đổi mới công nghệ.

Doanh nghiệp sử dụng AI, từ startup công nghệ đến tập đoàn lớn, đều bị ảnh hưởng bởi các quy định này. Dưới đây là một số tác động chính:

Tăng chi phí tuân thủ: Các công ty cần đầu tư vào việc kiểm tra và tối ưu hóa hệ thống AI để đáp ứng các yêu cầu pháp lý.

Tăng tính minh bạch: Doanh nghiệp phải công khai cách AI hoạt động, từ dữ liệu đầu vào đến cách đưa ra quyết định.

Cơ hội đổi mới: Quy định rõ ràng tạo môi trường an toàn để phát triển các giải pháp AI sáng tạo.

Ví dụ, một công ty phát triển AI chẩn đoán y tế cần đảm bảo rằng hệ thống của họ tuân thủ EU AI Act, từ việc sử dụng dữ liệu bệnh nhân đến độ chính xác của thuật toán.

Để tuân thủ các quy định AI, doanh nghiệp và cá nhân cần thực hiện các bước sau:

Hiểu rõ luật địa phương: Tìm hiểu các quy định cụ thể tại khu vực bạn hoạt động, như EU AI Act hoặc luật bảo vệ dữ liệu GDPR.

Kiểm tra hệ thống AI: Đảm bảo các thuật toán không có thiên vị và được kiểm tra thường xuyên.

Đào tạo nhân sự: Đội ngũ phát triển AI cần được đào tạo về đạo đức và trách nhiệm pháp lý.

Hợp tác với chuyên gia pháp lý: Làm việc với các luật sư chuyên về công nghệ để đảm bảo tuân thủ.

Ngoài ra, các cá nhân sử dụng AI, như nhà phát triển hoặc người dùng cuối, cũng nên tìm hiểu về cách các công cụ AI hoạt động để tránh vi phạm pháp luật vô tình.

Sự khác biệt giữa các quốc gia: Các chính sách AI toàn cầu không đồng bộ, gây khó khăn cho các công ty hoạt động đa quốc gia.

Chi phí tuân thủ cao: Đặc biệt đối với các startup nhỏ, việc đáp ứng các yêu cầu pháp lý có thể tốn kém.

Cân bằng giữa đổi mới và kiểm soát: Quy định quá nghiêm ngặt có thể kìm hãm sự phát triển của AI.

Tăng niềm tin của người dùng: Quy định rõ ràng giúp người dùng cảm thấy an tâm khi sử dụng AI.

Thúc đẩy cạnh tranh công bằng: Các công ty lớn và nhỏ đều phải tuân thủ cùng một luật lệ.

Khuyến khích đổi mới có đạo đức: Các quy định khuyến khích phát triển AI an toàn và minh bạch.

Tương lai của quy định AI sẽ phụ thuộc vào cách các quốc gia hợp tác để tạo ra một khung pháp lý toàn cầu. Một số xu hướng đáng chú ý:

Hợp tác quốc tế: Các tổ chức như OECD đang thúc đẩy các tiêu chuẩn AI chung trên toàn cầu.

Tăng cường giám sát AI nguy cơ cao: Các ứng dụng như AI trong quân sự hoặc tư pháp sẽ được kiểm soát chặt chẽ hơn.

Phát triển công cụ kiểm tra AI: Các công cụ tự động kiểm tra tính minh bạch và đạo đức của AI sẽ trở nên phổ biến.

Quy định AI không chỉ là những bộ luật khô khan, mà là công cụ giúp định hình tương lai của công nghệ trí tuệ nhân tạo. Từ EU AI Act đến các chính sách AI toàn cầu, các quy định này đảm bảo rằng AI được sử dụng một cách an toàn, minh bạch và có đạo đức. Dù bạn là doanh nghiệp, nhà phát triển hay người dùng cuối, việc hiểu và tuân thủ quy định AI sẽ giúp bạn tận dụng tối đa tiềm năng của công nghệ này mà không gặp rủi ro pháp lý.

Hãy bắt đầu bằng cách tìm hiểu các quy định tại khu vực của bạn và đảm bảo rằng các dự án AI của bạn tuân thủ các tiêu chuẩn mới nhất. Tương lai của AI không chỉ nằm ở công nghệ, mà còn ở cách chúng ta quản lý và sử dụng nó một cách có trách nhiệm.

Xem thêm:

Bình Luận